Các dòng chip mới nhất của Nvidia đã đạt được những bước tiến trong việc huấn luyện các hệ thống trí tuệ nhân tạo (AI) lớn, theo dữ liệu mới được công bố hôm thứ Tư, cho thấy số lượng chip cần thiết để huấn luyện các mô hình ngôn ngữ lớn đã giảm mạnh.

MLCommons – một tổ chức phi lợi nhuận chuyên công bố các kết quả đánh giá hiệu năng của hệ thống AI – đã công bố dữ liệu mới liên quan đến các dòng chip của Nvidia và Advanced Micro Devices (AMD), trong đó tập trung vào khâu huấn luyện AI, tức là quá trình cho hệ thống tiếp nhận lượng dữ liệu khổng lồ để học hỏi.

Mặc dù thị trường chứng khoán hiện đang quan tâm nhiều hơn đến mảng suy luận AI (AI inference) — nơi hệ thống AI xử lý câu hỏi từ người dùng — nhưng số lượng chip cần thiết để huấn luyện các hệ thống vẫn là một yếu tố cạnh tranh then chốt. Một công ty Trung Quốc là DeepSeek gần đây tuyên bố có thể tạo ra chatbot cạnh tranh chỉ với số lượng chip ít hơn nhiều so với các đối thủ Mỹ.

Đây là lần đầu tiên MLCommons công bố kết quả về hiệu suất huấn luyện các hệ thống AI như Llama 3.1 405B, một mô hình mã nguồn mở của Meta Platforms. Mô hình này sở hữu số lượng tham số đủ lớn để cho thấy khả năng xử lý của các dòng chip khi thực hiện những bài toán huấn luyện phức tạp nhất hiện nay, vốn có thể liên quan đến hàng ngàn tỷ tham số.

Trong nhóm này, Nvidia và các đối tác là những đơn vị duy nhất nộp dữ liệu về huấn luyện mô hình lớn như vậy. Kết quả cho thấy chip Blackwell mới của Nvidia có tốc độ gấp hơn hai lần so với thế hệ chip Hopper trước đó (tính trên mỗi chip).

Ở kết quả nhanh nhất, 2.496 chip Blackwell hoàn tất bài kiểm tra huấn luyện trong 27 phút. Trong khi đó, để đạt được thời gian nhanh hơn, cần sử dụng gấp hơn ba lần số lượng chip Hopper cũ, theo dữ liệu được công bố.

Tại một cuộc họp báo, ông Chetan Kapoor, Giám đốc sản phẩm của CoreWeave — công ty phối hợp với Nvidia trong một số thử nghiệm — cho biết ngành AI đang có xu hướng kết nối các nhóm chip nhỏ hơn thành những hệ phụ để thực hiện các tác vụ huấn luyện riêng biệt, thay vì sử dụng đồng nhất một cụm hàng trăm ngàn chip.

“Với phương pháp này, họ có thể tiếp tục tăng tốc hoặc rút ngắn thời gian huấn luyện những mô hình có quy mô cực lớn, với nhiều ngàn tỷ tham số,” ông Kapoor cho biết.

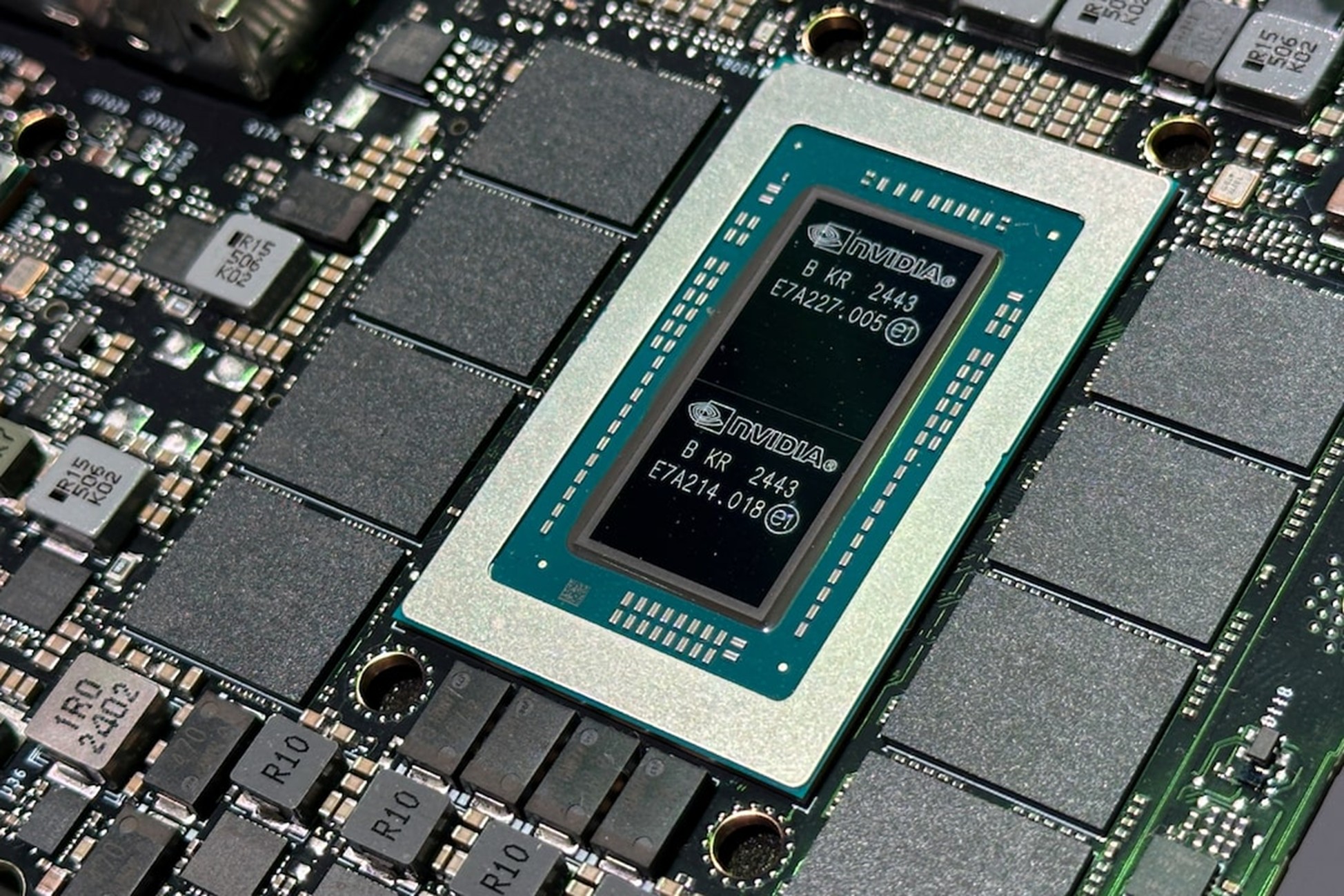

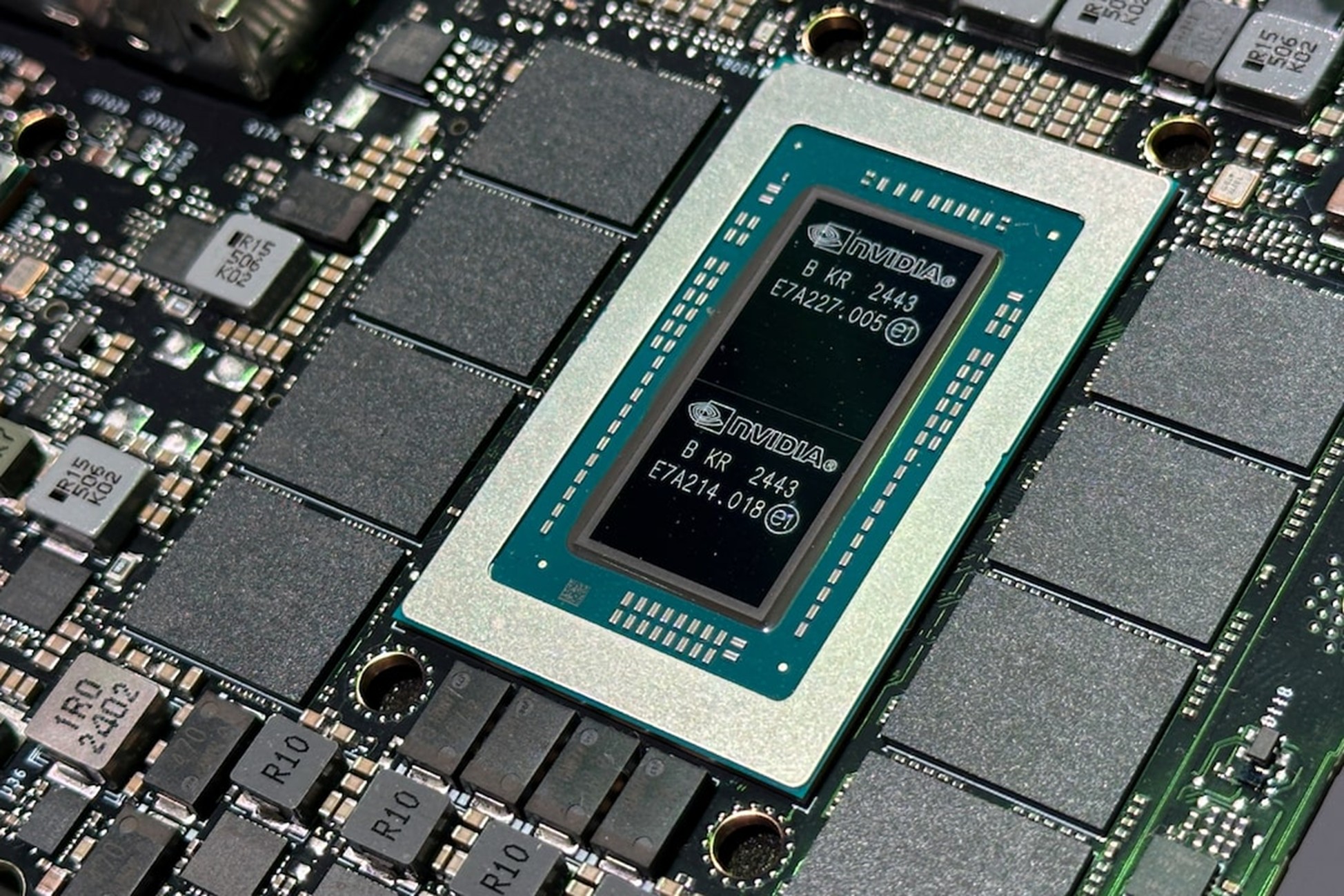

Siêu chip Nvidia GB10 Grace Blackwell được trưng bày tại hội nghị GTC của công ty tổ chức ở San Jose, California, Hoa Kỳ, ngày 19 tháng 3 năm 2025. Ảnh; Reuters

Siêu chip Nvidia GB10 Grace Blackwell được trưng bày tại hội nghị GTC của công ty tổ chức ở San Jose, California, Hoa Kỳ, ngày 19 tháng 3 năm 2025. Ảnh; Reuters