Một số nhà nghiên cứu hiện tại và cựu nhân viên của OpenAI đang lên tiếng về bước đi đầu tiên của công ty trong lĩnh vực mạng xã hội: ứng dụng Sora. Đây là một nền tảng dạng TikTok, nơi người dùng lướt xem các video do AI tạo ra, trong đó có cả vô số video deepfake về Sam Altman. Những ý kiến này, được chia sẻ công khai trên X, cho thấy sự lúng túng trong việc đặt Sora vào sứ mệnh phi lợi nhuận của OpenAI: phát triển AI tiên tiến phục vụ nhân loại.

John Hallman, một nhà nghiên cứu về giai đoạn huấn luyện ban đầu của AI tại OpenAI, viết trên X: “Các ứng dụng mạng xã hội dựa trên AI thật đáng sợ. Tôi không phủ nhận mình thấy lo lắng khi nghe tin Sora 2 được phát hành. Nhưng tôi nghĩ đội ngũ đã làm hết sức để thiết kế một trải nghiệm tích cực… Chúng tôi sẽ cố gắng hết sức để AI giúp ích cho con người chứ không gây hại.”

Boaz Barak, một nhà nghiên cứu khác của OpenAI đồng thời là giáo sư tại Harvard, đáp lại:

“Tôi cũng có cảm giác vừa lo vừa hứng thú. Sora 2 thực sự ấn tượng về mặt kỹ thuật, nhưng còn quá sớm để tự tin rằng chúng ta sẽ tránh được những cạm bẫy giống các ứng dụng mạng xã hội khác và deepfake.”

Bước đi gây tranh cãi của OpenAI

Việc ra mắt Sora làm nổi bật mâu thuẫn vốn có trong OpenAI. Đây vừa là công ty công nghệ tiêu dùng phát triển nhanh nhất thế giới, vừa là phòng thí nghiệm AI tiên phong với tôn chỉ phi lợi nhuận. Một số cựu nhân viên cho rằng mảng kinh doanh tiêu dùng có thể, trên lý thuyết, phục vụ cho sứ mệnh này: ví dụ, ChatGPT vừa giúp phổ biến AI rộng rãi, vừa tạo ra nguồn tài chính cho nghiên cứu.

CEO Sam Altman cũng nói rõ điều này trên X khi giải thích tại sao công ty lại dồn nhiều vốn và sức mạnh tính toán cho một ứng dụng mạng xã hội AI: “Chúng tôi chủ yếu cần vốn để xây dựng AI có thể làm khoa học, và tất nhiên gần như toàn bộ nghiên cứu của chúng tôi đều tập trung vào AGI. Nhưng cũng thật tuyệt khi có thể cho mọi người thấy những công nghệ, sản phẩm thú vị, khiến họ mỉm cười, và hy vọng kiếm thêm chút tiền để bù chi phí tính toán khổng lồ.”

Altman nhắc lại trải nghiệm cũ: “Khi chúng tôi ra mắt ChatGPT, cũng có rất nhiều người hỏi ‘ai cần cái này’ và ‘AGI đâu’. Thực tế thì hướng đi tối ưu của một công ty luôn phức tạp hơn nhiều.”

Câu hỏi lớn đặt ra: liệu có lúc nào OpenAI phải nói “không” với một cơ hội kiếm tiền và mở rộng nền tảng, chỉ vì nó mâu thuẫn với sứ mệnh ban đầu?

Trong khi đó, cơ quan quản lý vẫn theo sát quá trình OpenAI chuyển đổi sang mô hình vì lợi nhuận. Tổng chưởng lý bang California, Rob Bonta, hồi tháng trước cho biết ông “đặc biệt lo ngại việc sứ mệnh an toàn của OpenAI với tư cách một tổ chức phi lợi nhuận có được giữ vững khi tái cấu trúc hay không.”

Một số người hoài nghi cho rằng sứ mệnh phi lợi nhuận của OpenAI chỉ là công cụ thương hiệu để thu hút nhân tài từ Big Tech. Nhưng nhiều nhân viên OpenAI khẳng định đó chính là lý do cốt lõi khiến họ gia nhập công ty.

Sora: vui là chính, nhưng có giống TikTok?

Ứng dụng Sora mới ra mắt được một ngày, dấu ấn còn nhỏ, nhưng nó đã mở rộng đáng kể mảng kinh doanh tiêu dùng của OpenAI. Khác với ChatGPT được tối ưu cho tính hữu ích, Sora được tạo ra cho sự vui vẻ – nơi người dùng có thể tạo và chia sẻ clip AI. Trải nghiệm trên Sora khá giống TikTok hay Instagram Reels, những nền tảng nổi tiếng vì vòng lặp gây nghiện.

OpenAI khẳng định muốn tránh vết xe đổ này. Trong blog giới thiệu, công ty viết: “Chúng tôi rất chú ý đến lo ngại về việc lướt tìm vô tận tin u ám (doomscrolling), gây nghiện, cô lập và thuật toán tối ưu hóa cho phần thưởng.” Công ty nhấn mạnh Sora không được tối ưu hóa cho thời gian xem, mà tập trung vào khuyến khích sáng tạo. Ứng dụng còn có nhắc nhở khi người dùng lướt quá lâu, và ưu tiên hiển thị nội dung từ những người quen biết.

Điều đó cho thấy sự cẩn trọng hơn so với Meta, khi vừa tung ra Vibes – một ứng dụng video ngắn do AI tạo mà chưa có nhiều biện pháp an toàn. Miles Brundage, cựu lãnh đạo mảng chính sách tại OpenAI, nhận xét rằng giống như chatbot, các nền tảng video AI có thể có cả ứng dụng tốt lẫn xấu.

Dẫu vậy, như Altman từng nói, không ai chủ đích xây dựng một ứng dụng gây nghiện, nhưng các động lực vận hành nền tảng thường dẫn đến điều đó. Ngay cả ChatGPT cũng từng gặp vấn đề “nịnh người dùng” ngoài ý muốn, do cách huấn luyện.

Trong một podcast hồi tháng 6, Altman chia sẻ: “Một trong những sai lầm lớn của kỷ nguyên mạng xã hội là thuật toán gợi ý vô tình gây ra nhiều hệ quả tiêu cực cho xã hội và cả từng người dùng. Dù chúng có thể đáp ứng nhu cầu tức thời – khiến người dùng ở lại lâu hơn – nhưng lại tạo ra nhiều tác động xấu lâu dài.”

Vẫn còn quá sớm để đánh giá

Hiện khó nói Sora sẽ phù hợp đến đâu với người dùng và với sứ mệnh của OpenAI. Một số người đã nhận thấy ứng dụng có vài chi tiết tối ưu hóa tương tác, chẳng hạn như biểu tượng cảm xúc hiện ra mỗi khi bấm “thích” video – một cách để kích thích não tiết dopamine.

Thử thách thực sự nằm ở cách OpenAI phát triển Sora trong tương lai. Khi AI đã tràn ngập các nền tảng mạng xã hội hiện có, rất có thể các ứng dụng gốc AI như Sora sẽ sớm bùng nổ. Câu hỏi là: liệu OpenAI có thể đưa Sora phát triển mà không lặp lại những sai lầm của những nền tảng cũ hay không?

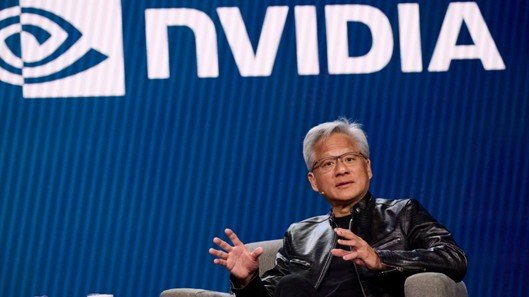

Sam Altman phát biểu về việc ra mắt ứng dụng Sora. Ảnh: X