Mỗi lần bạn đặt câu hỏi cho ChatGPT, bạn đang gây ra tiêu tốn năng lượng – nhưng bao nhiêu? Một nghiên cứu mới đã tiết lộ mức độ gây hại cho môi trường khi tương tác với các mô hình ngôn ngữ lớn (LLMs), và người dùng có thể làm gì để giảm dấu chân carbon của mình.

Các nhà nghiên cứu ở Đức đã chạy 14 mô hình ngôn ngữ mã nguồn mở – với quy mô từ 7 đến 72 tỷ tham số – qua 1.000 câu hỏi tiêu chuẩn và đo lường lượng khí CO₂ phát sinh từ mỗi phản hồi.

Họ phát hiện rằng các mô hình sử dụng lý luận nội bộ để “suy nghĩ” trước khi trả lời có thể thải ra lượng khí gây hiệu ứng nhà kính cao gấp 50 lần so với những mô hình trả lời ngắn gọn.

Đồng thời, các mô hình có nhiều tham số hơn – vốn thường chính xác hơn – cũng tạo ra nhiều khí thải hơn.

Tuy nhiên, không chỉ các mô hình là vấn đề; cách người dùng tương tác với chúng cũng có ảnh hưởng lớn.

“Vì mọi người thể hiện lịch sự và dùng các từ như ‘làm ơn’ và ‘cảm ơn’, các mô hình LLM sẽ tạo ra những câu trả lời dài hơn,” Maximilian Dauner, nhà nghiên cứu tại Đại học Khoa học Ứng dụng Hochschule München và là tác giả chính của nghiên cứu, nói với BBC Science Focus. Đây cũng chính là những lệnh nhắc (prompts) gây tác động xấu đến môi trường.

“Điều này đồng nghĩa với việc nhiều từ hơn được tạo ra, tức mô hình sẽ chạy lâu hơn, cần nhiều điện hơn và phát thải nhiều CO₂ hơn.”

Những từ bổ sung này không làm tăng giá trị câu trả lời, nhưng lại tác động đáng kể đến môi trường.

“Dù mô hình tạo ra 10.000 từ hữu ích hay 10.000 từ vô nghĩa thì lượng CO₂ thải ra vẫn giống nhau,” Dauner nói.

Do đó, người dùng có thể giảm lượng khí thải bằng cách yêu cầu AI trả lời ngắn gọn, hoặc dùng gạch đầu dòng thay vì đoạn văn dài. Ngay cả việc yêu cầu tạo ảnh, kể chuyện cười hay viết bài luận một cách ngẫu nhiên khi không thật sự cần thiết cũng khiến khí hậu phải trả giá.

Nghiên cứu cũng phát hiện rằng các câu hỏi đòi hỏi suy luận sâu – như triết học hoặc đại số trừu tượng – tạo ra nhiều khí thải hơn hẳn so với các chủ đề đơn giản như lịch sử.

Mặc dù nhóm nghiên cứu sử dụng các mô hình nhỏ có thể chạy cục bộ, Dauner cho rằng mô hình lớn như ChatGPT – vốn có thể chạy với số tham số gấp hơn 10 lần – sẽ tiêu tốn nhiều năng lượng hơn rất nhiều.

“Khác biệt chính giữa các mô hình tôi thử nghiệm và các mô hình như Microsoft Copilot hay ChatGPT là số lượng tham số,” Dauner nói. Các mô hình mà nhiều người sử dụng hàng ngày thường có quy mô gấp 10 lần, và vì vậy để lại dấu chân carbon lớn gấp 10 lần.

Bên cạnh việc khuyến khích người dùng suy nghĩ kỹ trước khi đưa ra lời nhắc, Dauner cũng đề xuất một số giải pháp cho các công ty đứng sau các mô hình AI. Ví dụ, ông gợi ý phát triển các hệ thống lựa chọn mô hình nhỏ nhất có thể trả lời chính xác từng câu hỏi – giúp cắt giảm khí thải không cần thiết ở quy mô lớn.

“Tôi rất thích những công cụ này,” Dauner chia sẻ. “Tôi sử dụng chúng hàng ngày. Quan trọng là phải dùng một cách ngắn gọn và nhận thức được những gì đang xảy ra.”

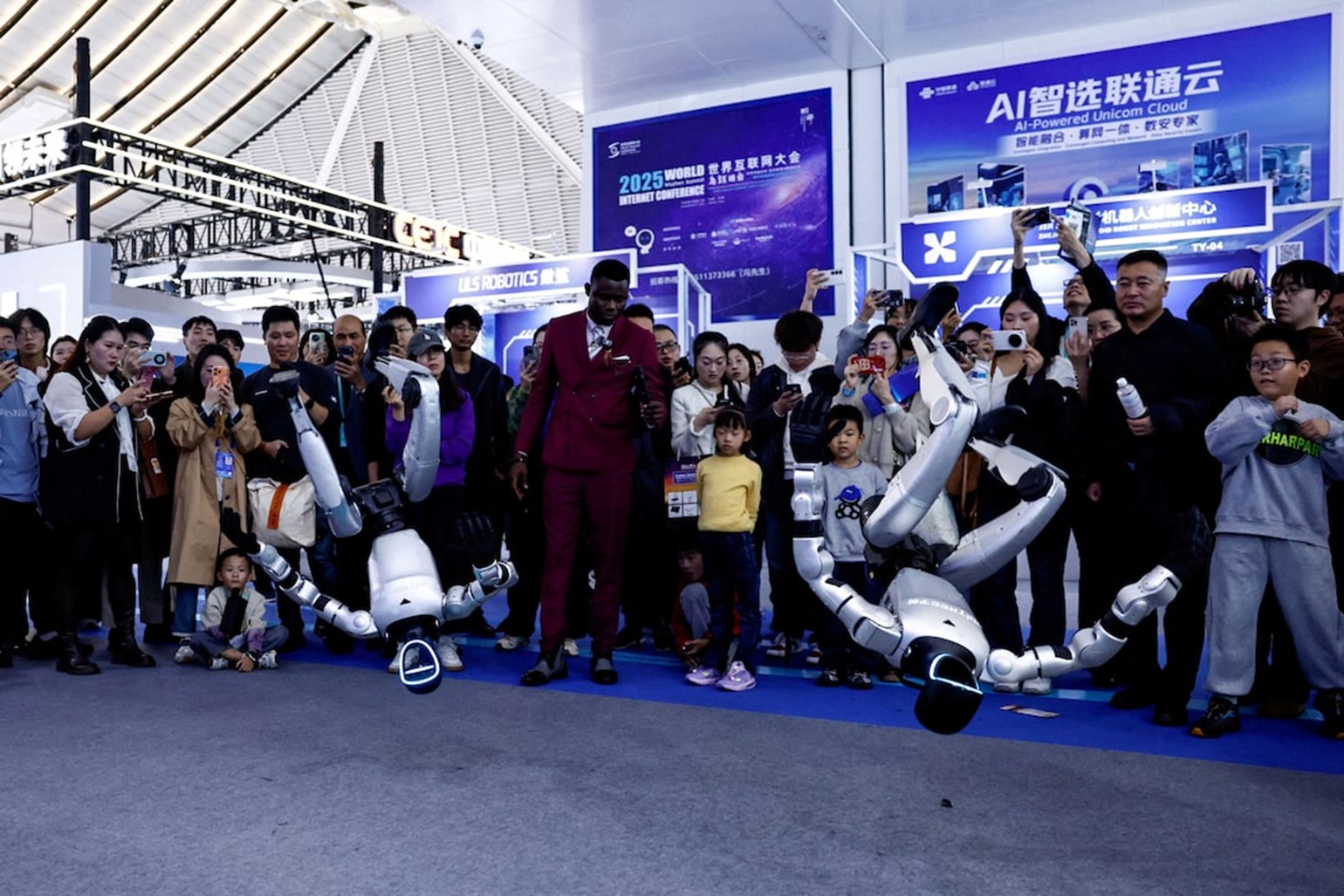

Một số mô hình AI phổ biến. Việc bạn lịch sự với AI tiêu tốn nhiều điện hơn. Ảnh: Getty.