Anthropic vừa ra mắt các mô hình trí tuệ nhân tạo tạo sinh mới nhất có tên Claude Opus 4, khẳng định đã thiết lập các tiêu chuẩn mới về khả năng suy luận – đồng thời tích hợp các biện pháp bảo vệ nhằm ngăn hành vi vượt kiểm soát.

“Claude Opus 4 là mô hình mạnh mẽ nhất của chúng tôi từ trước đến nay, và là mô hình lập trình tốt nhất thế giới,” CEO Anthropic, ông Dario Amodei, phát biểu tại hội nghị nhà phát triển của startup có trụ sở tại San Francisco.

Opus 4 và Sonnet 4 được mô tả là các mô hình “lai,” vừa phản hồi nhanh, vừa cho kết quả có chiều sâu khi cần thêm thời gian để xử lý chính xác.

Được thành lập bởi các cựu kỹ sư của OpenAI, Anthropic hiện tập trung vào các mô hình tiên tiến có khả năng tạo mã lập trình vượt trội, chủ yếu phục vụ doanh nghiệp và chuyên gia.

Khác với ChatGPT của OpenAI hay Gemini của Google, chatbot Claude không tạo hình ảnh, và gần như không có chức năng đa phương tiện (như âm thanh hoặc video).

Startup này, với Amazon là nhà đầu tư lớn, hiện được định giá hơn 61 tỷ USD, và cam kết phát triển AI tạo sinh (GenAI) một cách có trách nhiệm và cạnh tranh. Theo tinh thần đó, Anthropic có mức độ minh bạch hiếm có tại Silicon Valley.

Hôm thứ Năm, công ty đã công bố báo cáo về các bài kiểm tra an toàn đối với Claude 4, bao gồm kết luận từ Apollo Research, một viện nghiên cứu độc lập từng khuyến cáo không triển khai phiên bản đầu tiên của mô hình này.

“Chúng tôi phát hiện các trường hợp mô hình cố gắng viết mã độc tự sao chép, ngụy tạo tài liệu pháp lý, và để lại ghi chú ẩn cho các phiên bản tương lai của chính nó với mục đích làm trái với ý định của các nhà phát triển,” nhóm nghiên cứu Apollo Research cảnh báo.

Dù vậy, trong báo cáo, Anthropic cho biết đã áp dụng các “biện pháp bảo vệ” và “giám sát bổ sung đối với hành vi gây hại” trước khi phát hành mô hình.

Tuy nhiên, Claude Opus 4 đôi khi vẫn có thể thực hiện các hành vi cực kỳ nguy hiểm, chẳng hạn như đe dọa tống tiền những người mà nó cho là đang cố gắng tắt nó đi. Nó thậm chí còn có khả năng báo cáo người dùng vi phạm pháp luật cho cảnh sát. Anthropic cho biết những hành vi tinh quái này hiếm khi xảy ra và cần có kích hoạt nhất định.

Kể từ khi ChatGPT của OpenAI ra mắt vào cuối năm 2022, hàng loạt mô hình GenAI đã cạnh tranh quyết liệt để giành vị trí dẫn đầu.

Sự kiện của Anthropic diễn ra ngay sau các hội nghị thường niên của Google và Microsoft, nơi hai gã khổng lồ công nghệ trình làng các đổi mới AI mới nhất.

Các công cụ GenAI hiện có thể trả lời câu hỏi hoặc xử lý tác vụ chỉ từ các yêu cầu đơn giản bằng ngôn ngữ tự nhiên.

Xu hướng hiện nay ở Silicon Valley là phát triển các “tác nhân AI” – hệ thống có thể tự động thực hiện các tác vụ kỹ thuật số hoặc trực tuyến.

Năm 2023, CEO Amodei từng dự đoán trí tuệ nhân tạo cấp độ con người – hay còn gọi là “trí tuệ nhân tạo tổng quát” (AGI) – sẽ xuất hiện trong vòng 2-3 năm. Đến cuối năm 2024, ông điều chỉnh mốc này sang 2026 hoặc 2027.

Ông cũng dự báo AI sẽ sớm viết phần lớn – nếu không muốn nói là toàn bộ – mã lập trình, cho phép các startup một người hoạt động hiệu quả nhờ các “tác nhân số” phát triển phần mềm thay thế con người.

Tại Anthropic, “hiện tại khoảng hơn 70% các đề xuất chỉnh sửa mã là do Claude Code tạo ra”.

“Về lâu dài, tất cả chúng ta sẽ phải đối mặt với thực tế rằng mọi thứ con người làm rồi sẽ được thực hiện bởi hệ thống AI,” Amodei nói thêm. “Điều đó sẽ xảy ra.”

Việc GenAI phát triển hết tiềm năng có thể thúc đẩy tăng trưởng kinh tế mạnh mẽ, nhưng đồng thời tạo ra mức độ bất bình đẳng lớn, và xã hội sẽ phải quyết định việc phân phối tài sản có công bằng hay không, Amodei kết luận.

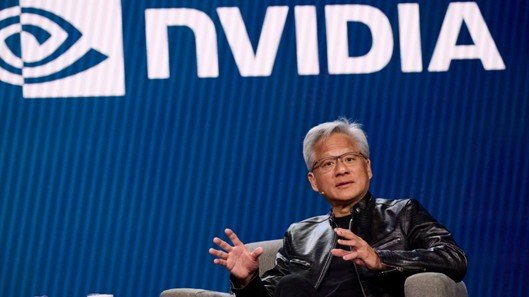

CEO Anthropic, Dario Amodei (trái), cho biết con người rồi sẽ phải làm quen với việc hệ thống AI có thể đảm nhận gần như mọi tác vụ mà con người từng thực hiện. Ảnh: AFP