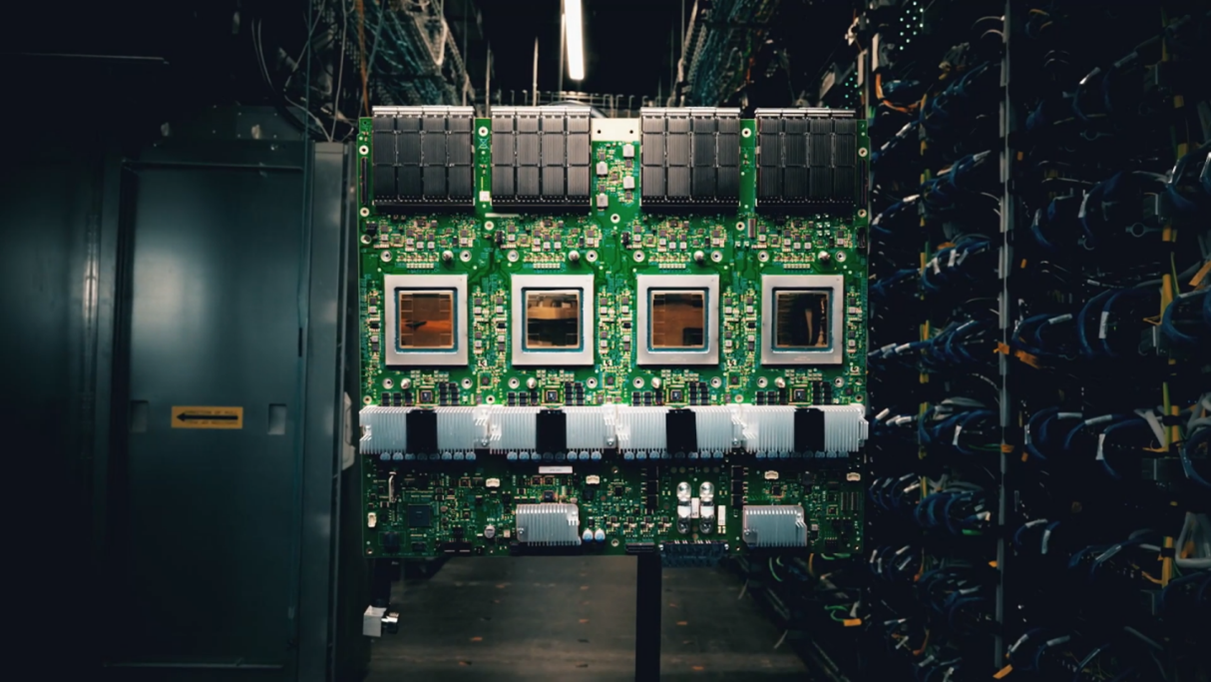

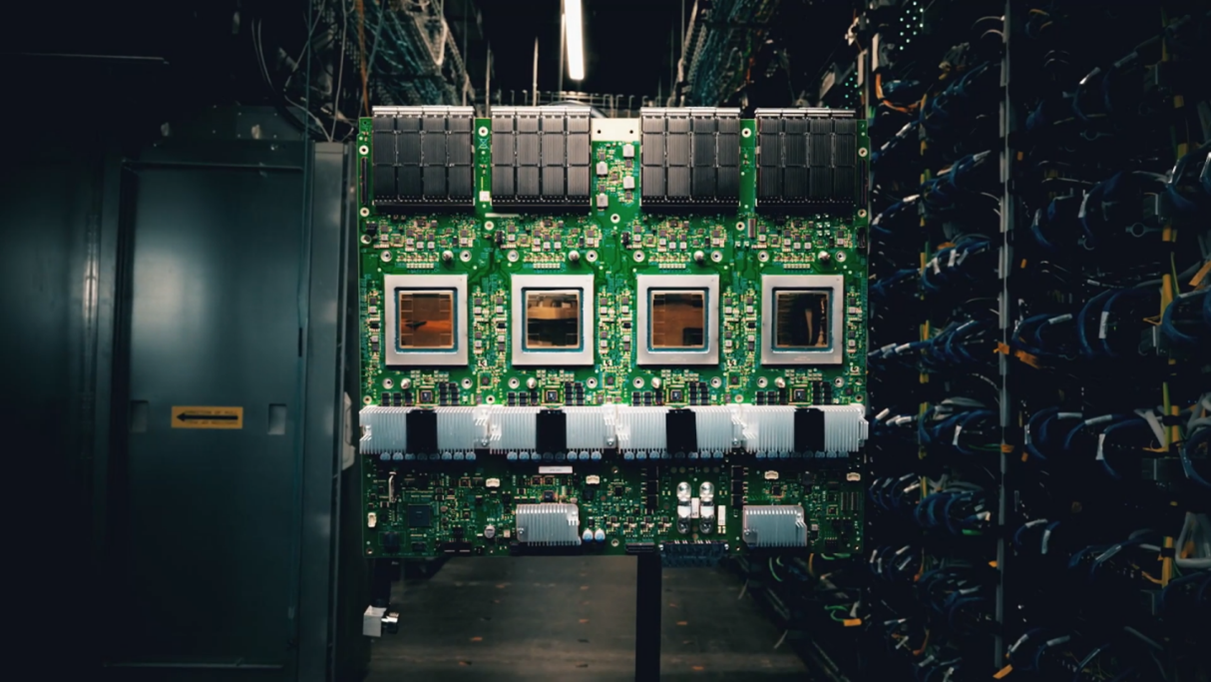

Google sắp bổ sung một phiên bản mới của bộ xử lý Tensor Processing Unit (TPU) mang tên Ironwood vào dịch vụ điện toán đám mây của mình. Con chip này được thiết kế để mang lại tốc độ và hiệu suất cao, giúp khách hàng vận hành các mô hình AI lớn với chi phí thấp hơn.

Theo các nhà phân tích, hiệu năng của Ironwood có thể sánh ngang chip GPU của Nvidia và AMD, vốn là công cụ chủ lực mà phần lớn doanh nghiệp hiện nay đang sử dụng. Điều này có thể tạo ra sự khác biệt lớn đối với các công ty đang phải chờ nhiều tháng để được mua GPU.

Myron Xie, nhà phân tích tại SemiAnalysis, cho biết Google vẫn có thể đối mặt với những hạn chế riêng. TSMC, công ty Đài Loan sản xuất chip cho Google, đang gặp khó khăn do nhu cầu quá cao đối với công nghệ đóng gói tiên tiến — bước cần thiết để kết nối nhiều vi mạch nhỏ thành một bộ xử lý lớn. Những hạn chế này có thể làm chậm tiến độ tung ra Ironwood, theo ông Xie.

Ironwood là thế hệ thứ bảy trong dòng TPU của Google. Con chip này được thiết kế để tích hợp chặt chẽ với TensorFlow, khung AI mã nguồn mở của Google, vốn được dùng trong nhiều dự án của giới nghiên cứu và doanh nghiệp. Theo nhà phân tích Alexander Harrowell của Omdia, TPU có lợi thế khi đào tạo hoặc chạy các mô hình được xây dựng trên TensorFlow.

“Rất nhiều mô hình AI, đặc biệt trong lĩnh vực nghiên cứu và doanh nghiệp, được phát triển bằng TensorFlow,” ông nói. “TPU được tối ưu hóa cao cho các tác vụ này, trong khi GPU đa năng hỗ trợ nhiều nền tảng khác nhau lại không chuyên biệt bằng.”

Về mặt hiệu suất, mỗi chip Ironwood cung cấp 4.614 teraflop FP8 và có 192 GB bộ nhớ HBM3E với băng thông 7,37 terabyte mỗi giây — cho thấy khả năng xử lý dữ liệu cực nhanh. Một cụm Ironwood (gọi là pod) có thể mở rộng lên tới 9.216 bộ tăng tốc, đạt công suất 42,5 exaflop FP8. Trong khi đó, hệ thống Nvidia GB300 NVL72 mới chỉ đạt 0,36 exaflop.

Các pod này có thể kết hợp thành cụm lớn hơn, được Google gọi là siêu máy tính AI dựa trên đám mây (AI Hypercomputer). Hệ thống này hợp nhất tính toán, lưu trữ và mạng dưới một lớp điều khiển duy nhất, cho phép doanh nghiệp huấn luyện và triển khai mô hình trên hàng nghìn bộ xử lý như thể chỉ là một máy duy nhất.

Để đảm bảo hoạt động trơn tru, Google sử dụng chuyển mạch quang học, tự động định tuyến lại dữ liệu khi phần cứng gặp sự cố mà không gián đoạn công việc.

Theo ước tính của IDC, khách hàng sử dụng hệ thống Hypercomputer của Google đạt tỷ suất hoàn vốn trung bình 353% sau ba năm, cùng chi phí CNTT giảm 28% và hiệu suất vận hành tăng 55% so với hạ tầng truyền thống.

Ai đang sử dụng Ironwood

Anthropic, một trong những công ty AI phát triển nhanh nhất, dự định sử dụng tới một triệu TPU để huấn luyện và vận hành các mô hình Claude của mình. Công ty cho biết Ironwood có tỷ lệ chi phí/hiệu năng vượt trội, giúp họ xử lý nhiều tác vụ hơn với chi phí thấp hơn.

Một số doanh nghiệp khác cũng đã bắt đầu ứng dụng Ironwood, như Lightricks, hãng nổi tiếng với các công cụ sáng tạo, đang dùng chip này để huấn luyện mô hình LTX-2 kết hợp văn bản và hình ảnh.

Bản thân Google cũng tăng đơn đặt hàng gia công sản xuất TPU mỗi năm để đáp ứng nhu cầu — cả cho khách hàng lẫn cho chính các dịch vụ AI của mình. Theo ông Harrowell, Google dự kiến chi 9,8 tỷ USD mua TPU từ Broadcom vào năm 2025, tăng từ 6,2 tỷ USD năm 2024 và 2 tỷ USD năm 2023. Điều này đưa chương trình TPU của Google chỉ đứng sau Nvidia, chiếm khoảng 5% thị phần chip AI, trong khi Nvidia vẫn nắm khoảng 78%.

Thách thức phía trước

Dù có lợi thế về hiệu năng, nhiều doanh nghiệp có thể chưa vội chuyển sang Ironwood. Ông Brandon Hoff, Giám đốc nghiên cứu tại IDC, nhận xét hầu hết các công ty đã xây dựng hệ thống của họ quanh phần mềm CUDA của Nvidia đã ra đời từ năm 2007.

“Các khách hàng doanh nghiệp đang tự viết mã suy luận (inferencing) sẽ bị ràng buộc vào nền tảng phần mềm của Nvidia,” ông nói. Trong khi đó, TensorFlow chỉ được phát hành từ năm 2015, khiến nhiều hệ thống cũ vẫn phụ thuộc vào CUDA.

Khoảng cách về phần mềm này có thể làm chậm tốc độ phổ biến của TPU, dù Google đang thu hẹp khoảng cách về phần cứng. Tuy nhiên, hiệu suất, khả năng mở rộng và tính tích hợp với TensorFlow của Ironwood vẫn có thể thu hút các nhóm nghiên cứu và công ty AI mới, vốn ít bị ràng buộc với hạ tầng cũ.

Hoàn thiện hệ sinh thái chip của Google

Ironwood chỉ là một phần trong chiến lược chip toàn diện của Google. Trong suốt thập kỷ qua, Google đã tự phát triển chip cho nhiều sản phẩm — từ bộ xử lý Tensor trong điện thoại Pixel đến bộ điều khiển Titanium dùng trong trung tâm dữ liệu.

Hiện hãng cũng đang tung ra Axion là CPU đa dụng đầu tiên dựa trên kiến trúc Arm dành cho máy chủ đám mây. Axion mang lại hiệu năng cao hơn 50% và hiệu quả năng lượng cao hơn 60% so với các chip x86 hiện có, theo Google.

Khi kết hợp CPU Axion, TPU Ironwood và bộ điều khiển Titanium, Google sở hữu chuỗi chip nội bộ hoàn chỉnh để vận hành các dịch vụ AI và điện toán đám mây — giúp hãng giảm phụ thuộc vào nhà cung cấp bên ngoài và cạnh tranh trực tiếp hơn với Nvidia và AMD.

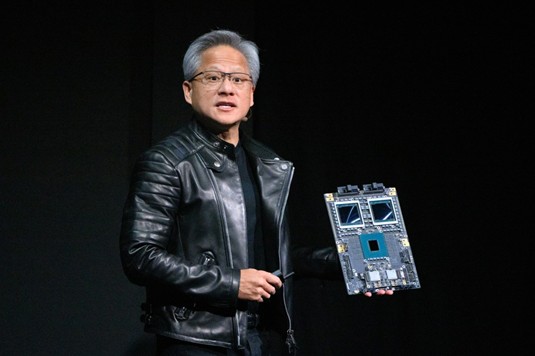

Bộ xử lý Tensor thế hệ mới của Google, có tên mã Ironwood, được thiết kế để tăng hiệu suất cho các tác vụ AI trong trung tâm dữ liệu. Ảnh: Techwire Asia