Các nhà hoạch định an ninh quốc gia rất thường phải đối mặt với những biến cố nằm ngoài tầm kiểm soát hay dự liệu của họ. Cuộc tấn công ngày 11/9 đã khiến chính quyền George W. Bush đảo ngược kế hoạch giảm vai trò toàn cầu của Mỹ. Các cuộc cách mạng ở thế giới Ả Rập buộc Tổng thống Barack Obama quay lại Trung Đông dù đang cố rút chân khỏi khu vực. Và cuộc xâm lược Ukraine của Nga đã phá vỡ nỗ lực của chính quyền Biden trong việc xây dựng quan hệ “ổn định và dễ đoán” với Moscow để tập trung vào cạnh tranh chiến lược với Trung Quốc.

Dù các xu hướng và động lực dẫn tới những sự kiện này phần nào có thể dự báo trước, nhưng các nhà hoạch định chính sách thường không chuẩn bị cho những kịch bản khó khăn nhất. Họ buộc phải điều chỉnh chiến lược trong lúc sự kiện đã xảy ra.

Sự phát triển nhanh chóng của trí tuệ nhân tạo (AI) – và khả năng xuất hiện của trí tuệ nhân tạo tổng quát (AGI) – hứa hẹn sẽ gây ra những biến động còn lớn hơn. Tín hiệu cho một cuộc chuyển đổi mạnh mẽ đang hiện diện khắp nơi. Cả Bắc Kinh và Washington đều coi việc giành vị thế dẫn đầu AI toàn cầu là ưu tiên chiến lược, và các công ty hàng đầu của Mỹ và Trung Quốc đang chạy đua để đạt đến AGI. Tin tức mỗi ngày đều đưa tin về các bước đột phá kỹ thuật, nguy cơ AI khiến người lao động mất việc, và cả nỗi lo về rủi ro toàn cầu như AI được dùng để tạo ra đại dịch chết người.

Không ai có thể chắc chắn con đường phát triển của AI hay tác động cụ thể của nó đến an ninh quốc gia. Vì vậy, các nhà hoạch định chính sách cần thảo luận chiến lược AI với thái độ khiêm tốn và thận trọng. Dù lạc quan hay bi quan, giới lãnh đạo an ninh quốc gia Mỹ vẫn phải sẵn sàng điều chỉnh chiến lược để ứng phó với những diễn biến có thể xảy ra ngay trong nhiệm kỳ tổng thống hiện tại. Washington cần chuẩn bị cho các đánh đổi chính sách, những biến động địa chính trị, và xác định ngay hôm nay các hành động thực tiễn để giảm rủi ro và nâng cao năng lực cạnh tranh. Nhiều ý tưởng hôm nay có thể bị coi là viển vông hoặc không cần thiết, nhưng sẽ trở nên cấp bách khi nhìn lại sau này.

TƯ DUY PHÁ VỠ KHUÔN MẪU

Hiện chưa có định nghĩa thống nhất về AGI, cũng chưa có sự đồng thuận về việc nó sẽ xuất hiện khi nào và bằng cách nào. Tuy nhiên, các mô hình AI tiên tiến hiện nay đã có thể xử lý ngày càng nhiều nhiệm vụ nhận thức phức tạp hơn cả con người. Từ khi ChatGPT ra đời năm 2022, sức mạnh của AI đã tăng vọt. Có lý do để tin rằng các mô hình này sẽ ngày càng mạnh mẽ, tự động hóa hơn, và lan rộng trong những năm tới.

Tuy nhiên, kỷ nguyên AGI có thể sẽ không mở màn bằng một sự kiện gây chấn động như vụ thử vũ khí hạt nhân đầu tiên. Và khác với thời kỳ hạt nhân, hoàn cảnh hiện tại lại không thuận lợi cho các nhà hoạch định Mỹ. Ngày xưa, chính phủ Mỹ kiểm soát công nghệ mới và có tới hai thập kỷ để xây dựng khung chính sách trước khi có đối thủ cạnh tranh. Giờ đây, Trung Quốc đã là đối thủ công nghệ gần ngang hàng, một số công ty tư nhân đang dẫn dắt quá trình phát triển, và AI là công nghệ dùng chung đang lan tỏa khắp nền kinh tế và xã hội.

Trong bối cảnh biến động này, các nhà lãnh đạo an ninh quốc gia cần tập trung nguồn lực để lên kế hoạch cho những kịch bản khó khăn nhưng có khả năng xảy ra. Đây không chỉ là các cú sốc đối với hiện trạng, mà còn là dấu hiệu cho thấy những tương lai khác biệt.

Ví dụ như khi một công ty Mỹ tuyên bố đã đạt bước nhảy vọt công nghệ dẫn đến AGI. Lãnh đạo Mỹ sẽ phải quyết định liệu có nên coi công ty này là “tài sản an ninh quốc gia” hay không – một danh xưng giúp họ nhận hỗ trợ công, bảo vệ cơ sở vật chất, truy cập dữ liệu nhạy cảm, mua chip tiên tiến và được miễn trừ một số quy định. Ngược lại, một công ty Trung Quốc cũng có thể tuyên bố đạt được AGI trước các đối thủ Mỹ.

Các nhà hoạch định chính sách sẽ phải cân nhắc giữa các đánh giá mâu thuẫn và đôi khi đối lập, dẫn đến lựa chọn khác nhau về mức độ rủi ro có thể chấp nhận và ưu tiên mối quan tâm nào. Nếu thiếu hệ thống phân tích độc lập và mạnh mẽ, chính phủ Mỹ có thể không xác minh được tính xác thực của các tuyên bố công nghệ. Đồng thời, họ cũng phải cân nhắc khả năng AGI đem lại lợi thế chiến lược cho Trung Quốc – chẳng hạn như khả năng khai thác lỗ hổng hạ tầng Mỹ nhanh hơn tốc độ phòng thủ mạng có thể vá lỗi của Mỹ. Khi đó, Washington có thể buộc phải hành động để làm chậm hoặc phá hoại quá trình phát triển AI của Trung Quốc, kéo theo nguy cơ xung đột leo thang.

Mặt khác, nếu lo ngại rằng các tổ chức phi nhà nước hoặc khủng bố có thể sử dụng công nghệ này để tạo ra vũ khí sinh học thảm khốc, các lãnh đạo Mỹ có thể sẽ phải chọn hợp tác với Bắc Kinh nhằm ngăn chặn sự phổ biến của mối đe dọa toàn cầu này.

Để nâng cao khả năng sẵn sàng cho các kịch bản AGI, Mỹ cần hiểu rõ hơn về hệ sinh thái AI trong và ngoài nước. Các cơ quan chính phủ cần theo sát quá trình phát triển của AI để xác định nơi nào có khả năng tạo ra bước đột phá – từ đó giảm thiểu nguy cơ bất ngờ chiến lược và đưa ra quyết định đúng đắn về điểm nghẽn cần ưu tiên hay lỗ hổng cần khai thác để làm chậm Trung Quốc.

Các nhà làm chính sách cũng cần mở rộng hợp tác với khu vực tư nhân và các quốc gia khác. Một mối quan hệ đối tác công – tư hai chiều, linh hoạt và có thể mở rộng là điều thiết yếu cho chiến lược đối phó thách thức từ AI hiện tại, và càng quan trọng hơn trong thế giới AGI. Sự nghi kỵ giữa chính phủ và tư nhân có thể làm tê liệt nỗ lực ứng phó khủng hoảng.

Mỹ cũng cần phát triển chính sách chia sẻ thông tin nhạy cảm về AI tiên tiến với đồng minh và đối tác. Nếu không có chính sách này, rất khó hình thành liên minh quốc tế nhằm đối phó với khủng hoảng do AI gây ra, giảm thiểu rủi ro toàn cầu, và buộc các quốc gia, công ty chịu trách nhiệm khi hành xử vô trách nhiệm.

TRÍ TUỆ NHÂN TẠO THÙ ĐỊCH

Trí tuệ nhân tạo tổng quát (AGI) không chỉ làm phức tạp thêm bức tranh địa chính trị toàn cầu mà còn đặt ra những thách thức an ninh quốc gia chưa từng có. Hãy tưởng tượng một cuộc tấn công mạng quy mô lớn do AI gây ra, tàn phá các tổ chức tài chính, doanh nghiệp tư nhân và cơ quan chính phủ, làm tê liệt cả các hệ thống vật lý như hạ tầng trọng yếu hay robot công nghiệp. Trong thế giới ngày nay, việc xác định ai là thủ phạm của một cuộc chiến tranh mạng vốn đã rất khó khăn và mất nhiều thời gian. Còn trong một thế giới với AI ngày càng tiên tiến, tình hình sẽ phức tạp hơn nhiều. Các nhà hoạch định chính sách sẽ phải cân nhắc không chỉ khả năng đây là bước khởi đầu của một chiến dịch quân sự, mà còn khả năng đây là hành động của một tác nhân AI độc lập, có khả năng tự sao chép.

Việc chuẩn bị cho viễn cảnh này đòi hỏi đánh giá lại khả năng hiện tại liệu có đủ sức ứng phó với các thách thức tương lai hay không. Các chính phủ không thể trông chờ vào các công cụ và kỹ thuật hiện nay để nhanh chóng và chính xác đánh giá một mối đe dọa, chứ chưa nói đến việc phản ứng kịp thời. Với khả năng đã được chứng minh của AI trong việc đánh lừa và giả mạo, các hệ thống hiện tại có thể không phân biệt được liệu một tác nhân AI đang hoạt động độc lập hay theo chỉ đạo của kẻ thù. Các nhà hoạch định cần những phương pháp mới để đánh giá động cơ của nó và cách ngăn chặn leo thang.

Chuẩn bị cho kịch bản xấu nhất đòi hỏi phải xem lại các biện pháp “không cần quy trách nhiệm” như gia cố phòng thủ mạng hay cô lập các trung tâm dữ liệu có thể bị xâm nhập. Cũng cần đánh giá xem liệu các quy trình quân sự và việc duy trì hoạt động hiện tại có đủ sức ứng phó với các mối đe dọa từ AI thù địch hay không. Sự thiếu tin tưởng của công chúng đối với chính phủ và các công ty công nghệ sẽ càng khiến cho việc trấn an người dân trở nên khó khăn hơn nếu xảy ra chiến dịch tung tin sai lệch do AI gây ra. Vì AI độc lập nhiều khả năng không tôn trọng ranh giới quốc gia, các bước chuẩn bị phù hợp phải bao gồm thiết lập kênh liên lạc với cả đồng minh và đối thủ để có thể phối hợp ứng phó quốc tế hiệu quả.

Cách các nhà lãnh đạo chẩn đoán tác động bên ngoài của một mối đe dọa sắp xảy ra sẽ định hình phản ứng của họ. Khi xảy ra tấn công mạng, các nhà hoạch định chính sách sẽ phải ra quyết định theo thời gian thực: nên đóng mục tiêu cụ thể như hệ thống mạng hoặc trung tâm dữ liệu bị xâm nhập, hay nên tiến hành đóng cửa quy mô lớn nhằm ngăn nguy cơ AI tự sao chép lan rộng? Tuy phương án sau có thể ngăn leo thang, nhưng sẽ ảnh hưởng nghiêm trọng đến nền kinh tế số và các hệ thống thiết yếu như sân bay, nhà máy điện… Viễn cảnh mất kiểm soát này cho thấy rõ tầm quan trọng của việc làm rõ thẩm quyền pháp lý và xây dựng kế hoạch ứng phó. Nhìn rộng hơn, nó nhấn mạnh sự cấp bách trong việc thiết lập các chính sách và chiến lược kỹ thuật để xử lý xu hướng sai lệch hành vi của các mô hình AI tiên tiến.

Tối thiểu, kế hoạch nên bao gồm bốn loại hành động. Thứ nhất, xác lập các biện pháp “không hối tiếc” mà chính phủ và khu vực tư nhân có thể triển khai ngay để sẵn sàng ứng phó. Thứ hai, xây dựng các “kịch bản khẩn cấp” có thể cập nhật thường xuyên khi xuất hiện đe dọa, cơ hội hoặc ý tưởng mới. Thứ ba, đầu tư vào năng lực cốt lõi có giá trị trong nhiều kịch bản khác nhau. Cuối cùng, ưu tiên xác định sớm dấu hiệu thất bại chiến lược và tạo điều kiện để điều chỉnh hướng đi khi cần.

THẾ GIỚI MỚI, KHÔNG CHO PHÉP THÓI QUEN CŨ

Việc chuẩn bị cho tác động của AGI đến an ninh quốc gia cần bắt đầu ngay từ bây giờ. Trong một thế giới ngày càng cạnh tranh và bất ổn, với môi trường trong nước vừa mong manh về kinh tế vừa phân cực về chính trị, Mỹ không thể để bị bất ngờ.

Cho dù có thể AI sẽ chỉ trở thành một “công nghệ bình thường” — giống như Internet hay điện — có sức biến đổi sâu rộng nhưng tốc độ phổ biến vẫn trong tầm kiểm soát của chính phủ và xã hội, nhưng giả định như vậy là thiếu trách nhiệm. Chuẩn bị cho những thách thức khó khăn hơn có thể giúp các nhà lãnh đạo xác định được các vấn đề chiến lược cốt lõi và xây dựng công cụ ứng phó cũng hữu ích cho các tình huống nhẹ hơn. Cũng không nên cho rằng việc lập kế hoạch này sẽ dẫn đến các chính sách làm tăng rủi ro hoặc kìm hãm sự phát triển AI. Trong kỷ nguyên hạt nhân, chính việc chuẩn bị cho kịch bản khủng bố hạt nhân đã thúc đẩy các sáng kiến toàn cầu nhằm kiểm soát chặt nguyên liệu phân hạch, giúp thế giới an toàn hơn.

Càng nguy hiểm hơn nếu coi AGI là một “tình huống thông thường” trong an ninh quốc gia. Kiến thức công nghệ trong chính phủ còn hạn chế và không đồng đều; các bên liên quan không chỉ là các cơ quan an ninh truyền thống mà còn trải rộng ra các doanh nghiệp và tổ chức xã hội dân sự — những đối tượng không có mặt trong Phòng Tình huống của Nhà Trắng và cũng không đặt ưu tiên về an ninh quốc gia. Việc lập kế hoạch không thể giao phó cho các chuyên gia tương lai học bị tách biệt trong phòng kín. Mọi cuộc tranh luận chiến lược hôm nay đều phải lồng ghép yếu tố AGI.

Hiện đang có cuộc tranh luận sôi nổi về các chiến lược để vừa giành lợi thế AI vừa tránh thảm họa, nhưng vẫn còn thiếu các thảo luận nghiêm túc về việc AGI có thể định hình lại trật tự quốc tế, cán cân quyền lực toàn cầu và các liên minh địa chính trị như thế nào. Trong một thế giới đa cực, nhiều quốc gia mới nổi coi AI tiên tiến — và cách Mỹ cùng Trung Quốc phổ biến công nghệ AI và hạ tầng số đi kèm — là yếu tố then chốt cho tham vọng quốc gia của họ. Việc lên kế hoạch sớm, tổ chức diễn tập mô phỏng cùng các đồng minh và đối tác, cũng như duy trì đối thoại với những nước có lập trường nước đôi sẽ giúp đảm bảo các quyết định chiến lược mang lại lợi ích chung. Một chiến lược AI bỏ qua thế giới đa cực và hệ sinh thái công nghệ toàn cầu phân tán sẽ thất bại. Và một chiến lược an ninh quốc gia không tính đến ảnh hưởng có thể có của AGI sẽ sớm trở nên lỗi thời.

Lãnh đạo an ninh quốc gia không thể chọn lựa khủng hoảng nào sẽ xảy ra, nhưng họ có thể chọn điều gì cần chuẩn bị và phân bổ nguồn lực cho tương lai. Việc lên kế hoạch cho AGI không phải là trò viễn tưởng, cũng không phải là đánh lạc hướng khỏi các vấn đề hiện tại. Đó là hành động có trách nhiệm nhằm chuẩn bị cho khả năng rất thực về một loạt thách thức an ninh quốc gia mới trong một thế giới bị biến đổi tận gốc.

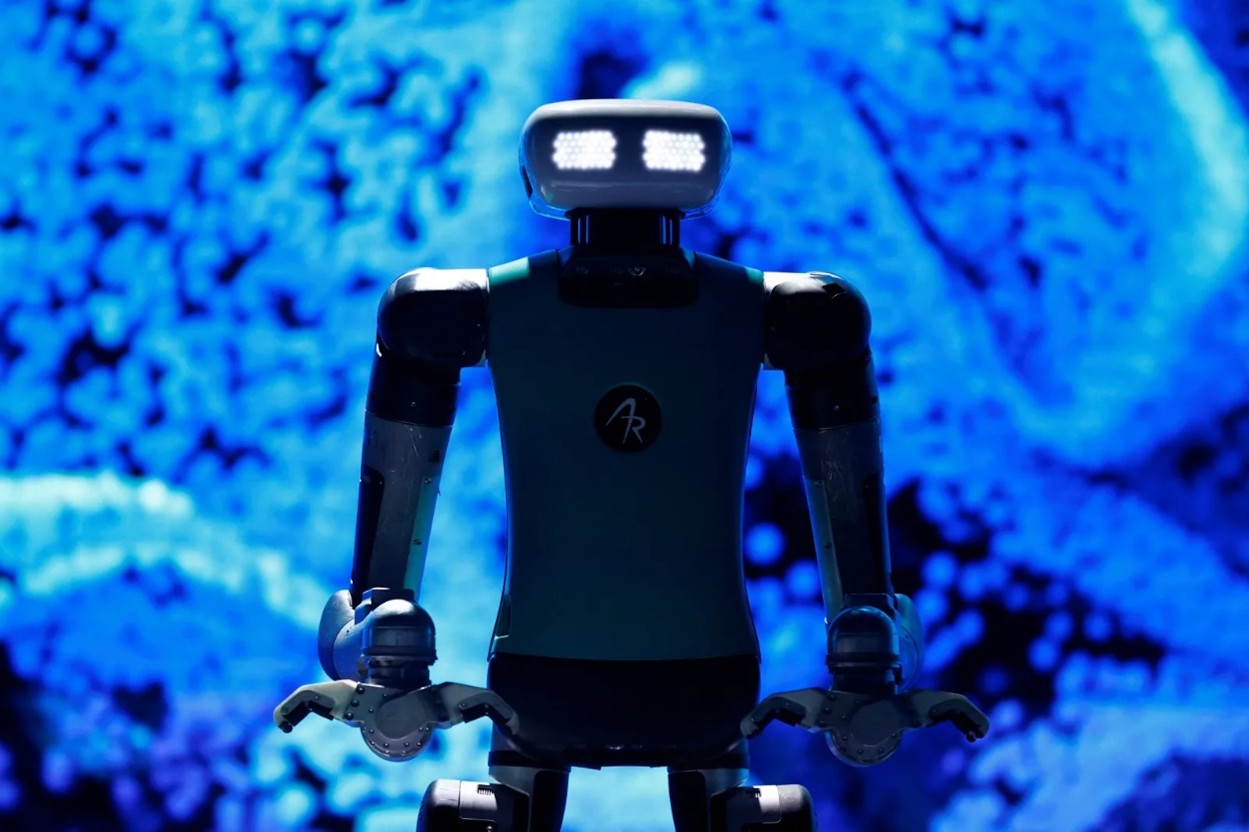

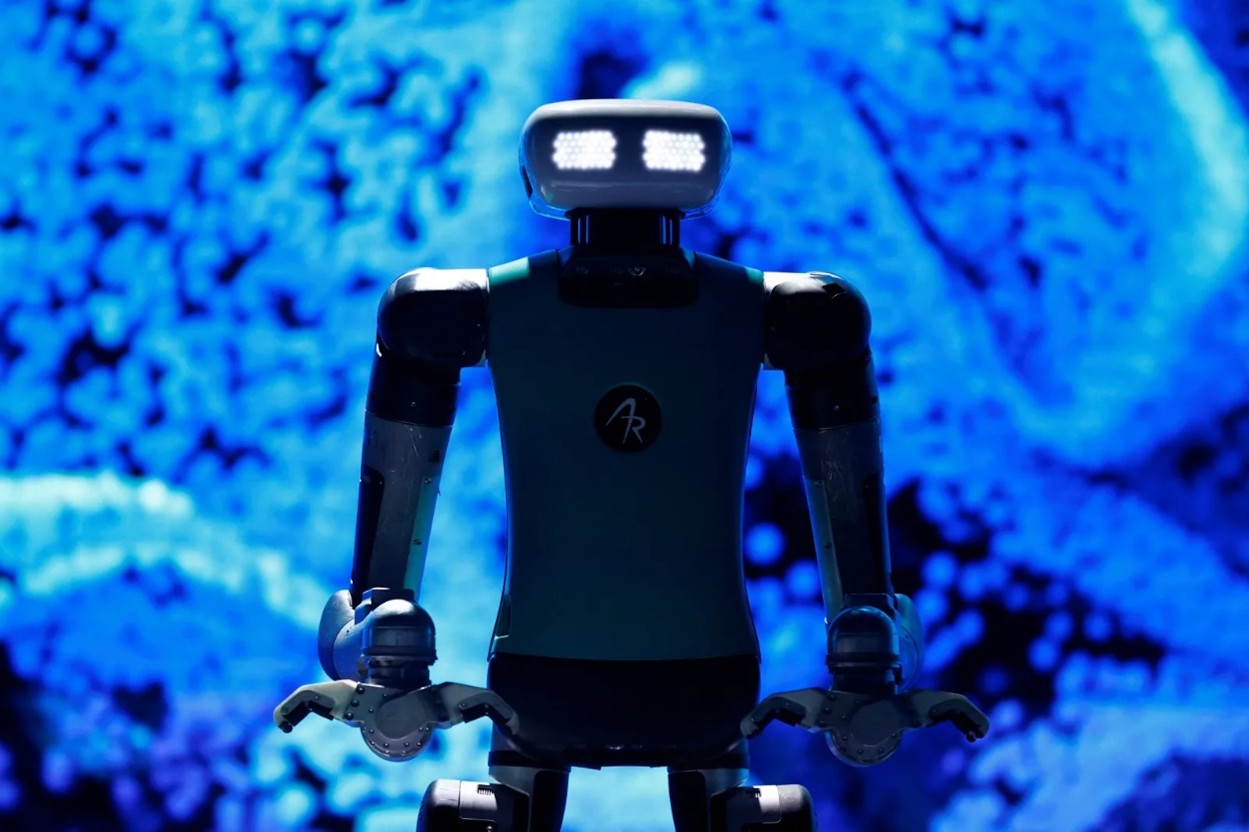

Một robot điều khiển bằng AI tại Triển lãm Di động Thế giới ở Barcelona, Tây Ban Nha, tháng 3/2025. Ảnh: Reuters